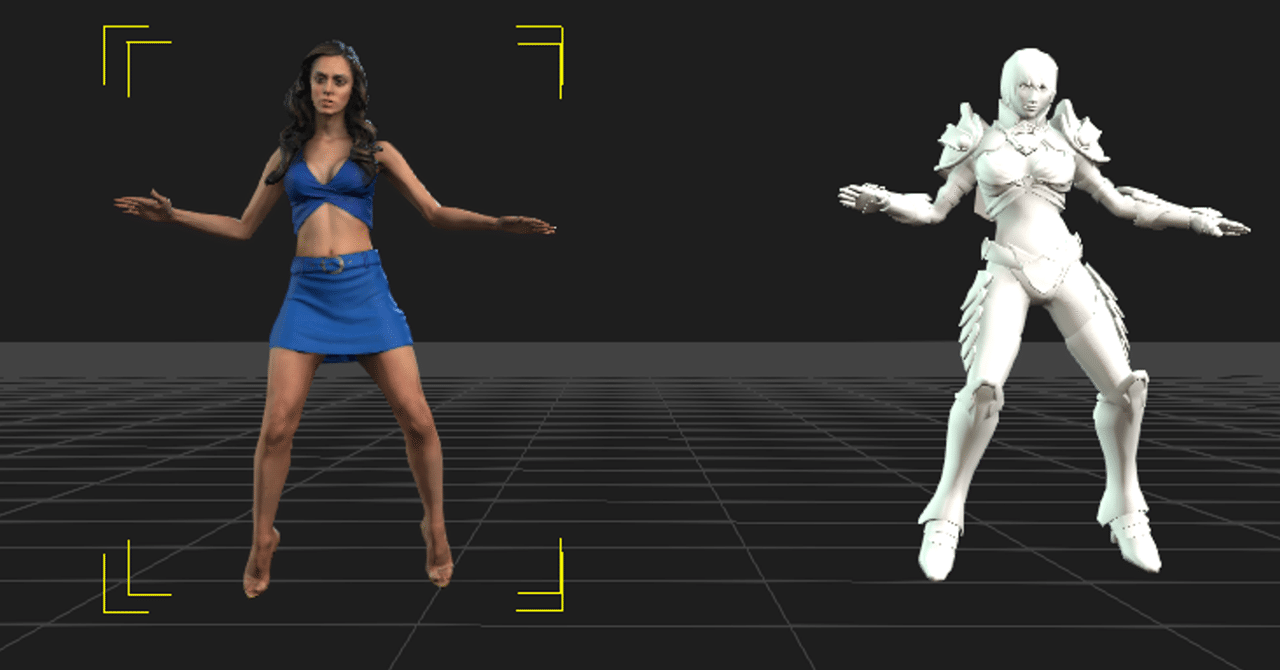

私は、先日動画をDensePoseに変換できる方法を知り、自分で踊ったダンスの動画をDensePoseに変換して、画像生成AIで作った画像を躍らせて動画を作ろうと試みを続けています。

こちらの動画に、まとめています。

こちらの記事も、読んでください。

ただMagic Animateを使う方法では、顔や服装が崩れてしまうなどして実用に耐える動画を作ることができず困っています。

そのため前回作ったように、動画をフレーム単位に分解して、画像生成する方法を試したいと思っていました。

前回の動画は、こちらです。

@itsupporter.mkのInstagram動画をチェック https://t.co/bj37Mc7PCl

— エンジニアM168 (@masaru21) April 1, 2024

前回は、動画をフレーム単位に分解して、Stable Diffusion Web Uiでバッチ処理して、画像生成して動画を作りました。

AnimateDiff

ただAnimateDiffを使う場合は、VRAMが12GB以上必要なようです。

そのためRTX3090というデスクトップパソコン向けでVRAMが24GBあるグラフィックボードやノートパソコンの場合は、RTX4080以上のグラフィックボードが搭載された機種を準備する必要があります。

もしくはGoogle Colabで有料プランを利用することを検討されることを、お勧めします。

Google Colab無料版では、Stable Diffusionを使って画像生成することができなくなっています。

ControlNetの新しいモードで、DensePoseを使って画像生成する方法を知りました。

この記事を読み久しぶりに、ControlNetを調べました。

Stable Diffusion WebUI Forgeでは、最初からControlNetが使えるようになっています。

そして、DensePoseを使うプリプロセッサを選択できます。

denseposeから始まるものを、見つけてください。

こちらの動画も、役立つと思います。

新しいControlNet、DensePoseを使って見よう https://t.co/UIZKOx1kiI @YouTubeより

— エンジニアM168 (@masaru21) April 1, 2024

Stable Diffusion WebUI ForgeのControlNetのモデルのインストール方法をご紹介されています。

StabilityMatrix を使ってStable Diffusion WebUI Forgeを使っている場合は、この画像のように、StabilityMatrixのモデル管理の画面で、ドラッグアンドドロップすると簡単で良いです。

こちらの記事で書かれている

”モデルをダウンロードする

ControlNetのNforDPSページにアクセスすると、32GBの大きなファイルをダウンロードすることができます。ダウンロードが完了したら、stabledifffWEBUIディレクトリ内の適切なフォルダに置く必要があります。”

は、ネット検索しても分かりませんでした。

でも、上記のYouTubeの動画で、ダウンロードのURLが分かりました。

ダウンロードは、こちらです。

関連した記事で、OpenPoseポーズ集を見つけました。

SDXLのControlNetのモデルのインストールは、下記の記事が役立ちます。