巨大データセットLAION-5BにCSAM(児童性的虐待素材、日本で児童ポルノと呼ばれるものに近い)が含まれることは昨年から指摘されhaveibeentrained.comで検索できるようになっていました。それを利用して個人が記事を書いても「信頼できるソースがない」といわれ問題にされませんでした。

LAION-5Bは無料でDLすることがでます。LAION-5Bを使用したStable Diffusionもオープンソースで公開されており企業でも学校でも使われています。データセットにCSAMが含まれているとすれば、それを追認することになります。また元の被害者のイメージが再現される可能性もあります。

知らずに使う人が多いと思い、繰り返し記事を書いてきました。

20日、スタンフォード大学の調査により実際にCSAMが含まれていることが確認されたという記事が出ました。疑いのある素材が3226あり外部で検証された1008件が削除されました。

調査が行われたのは9月以降であり58億以上あるデータセットのハイリスクコンテンツの限られた部分しか調査できず、さらに虐待的なコンテンツが存在する可能性が高いと報告されています。

LAIONは安全性を確認するまで一時的にデータセットを削除しました。

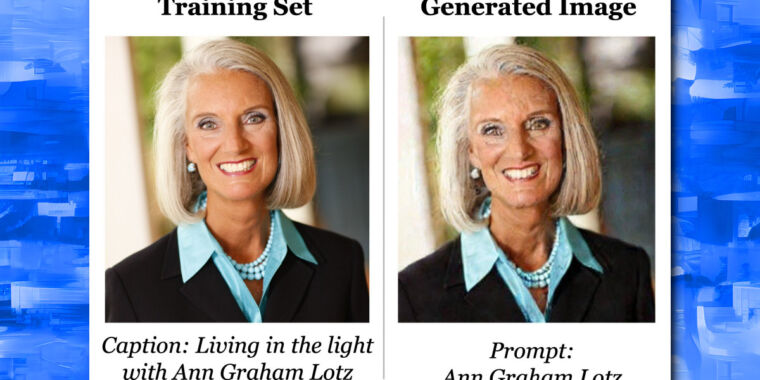

データセットのCSAMがモデルの出力に劇的な影響を与えるわけでは必ずしもありませんが、影響を及ぼしている可能性はあるということです。同一の事例が重複して存在することで特定の被害者のイメージが強化される危険性もあります。

調査を主導した主任技術者は適切な安全対策が施されていないStable Diffusion 1.5は性的に露骨なコンテンツを生成しており、それに基づくモデルの使用は可能な限り非推奨にし、配布を中止すべきであると勧告しています。

報告書の原文はこちらでDLできます。

関連記事

https://www.theregister.com/2023/12/20/csam_laion_dataset/

同じ画像が重複してデータセットに入っていると、過学習により記憶され元の画像と酷似した画像が生成される確率が上がります。調査したデータにも同じ被写体が多数含まれるケースがありました。

生成を繰り返すことにより間接的に元のCSAMの被害者の再被害化に寄与することになります。研究者による解説です。

Stable DiffusionだけでなくMidjourneyもLAION-5Bを使っていますがMidjourneyはコメントを拒否しました。

haveibeentrained.comも検索が使えなくなっています。