生成AIのデータセットに児童ポルノが入っている証拠を示せ、という投稿を見ましたので、単刀直入に書きます。あります。

日本の国会図書館で「清岡純子写真集 Best Selection!」が児童ポルノと判定され閲覧不可とされた清岡純子の少女ヌード写真がLAION-5Bで見つかります。LAION-5Bに含まれるデータを単語、画像で検索できるhaveibeentrained.comでアルファベットでSumiko Kiyookaと打ち込んで検索してください。すでに検索結果から削除されて出る写真は減っていますが、まだ残っている写真のデータが出ます。同じく人気の彩紋洋実撮影の少女ヌード写真も見つかりました。断っておきますが、芸術性の評価される写真家で、現在見ても問題ない写真もあります。それより問題のある誰が誰を撮影したか不明な児童ポルノがたくさんあります。それらがStable Diffusionの学習に使われ、結果的に児童ポルノを生成する人間の力になっています。

LAION-5Bには児童ポルノばかりでなく医療記録が入っており、偶然見つけた患者が抗議しています。臨床記録として医師が撮影した写真の流出だけでもあってはならないことですが、無許諾でデータセットに製品化されてしまった今では取り返すことができません。その患者の写真は本名と紐づけられていませんでした。他にも多くの医療記録がありますが、本人が確認することは困難です。しかもLAIONは画像ファイルを直接保有しているわけではないため、自分で掲載元から削除するしかないと答えています。

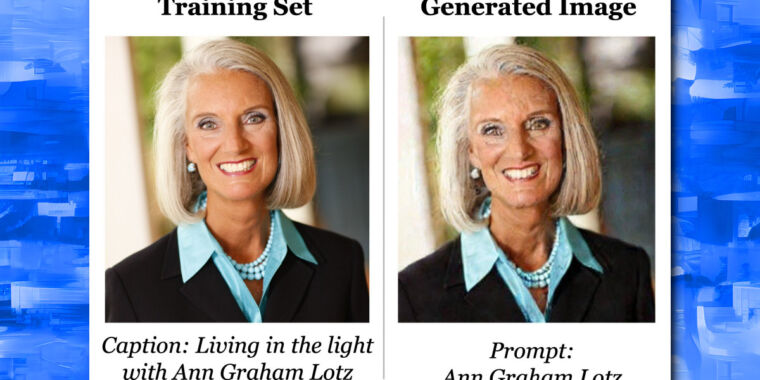

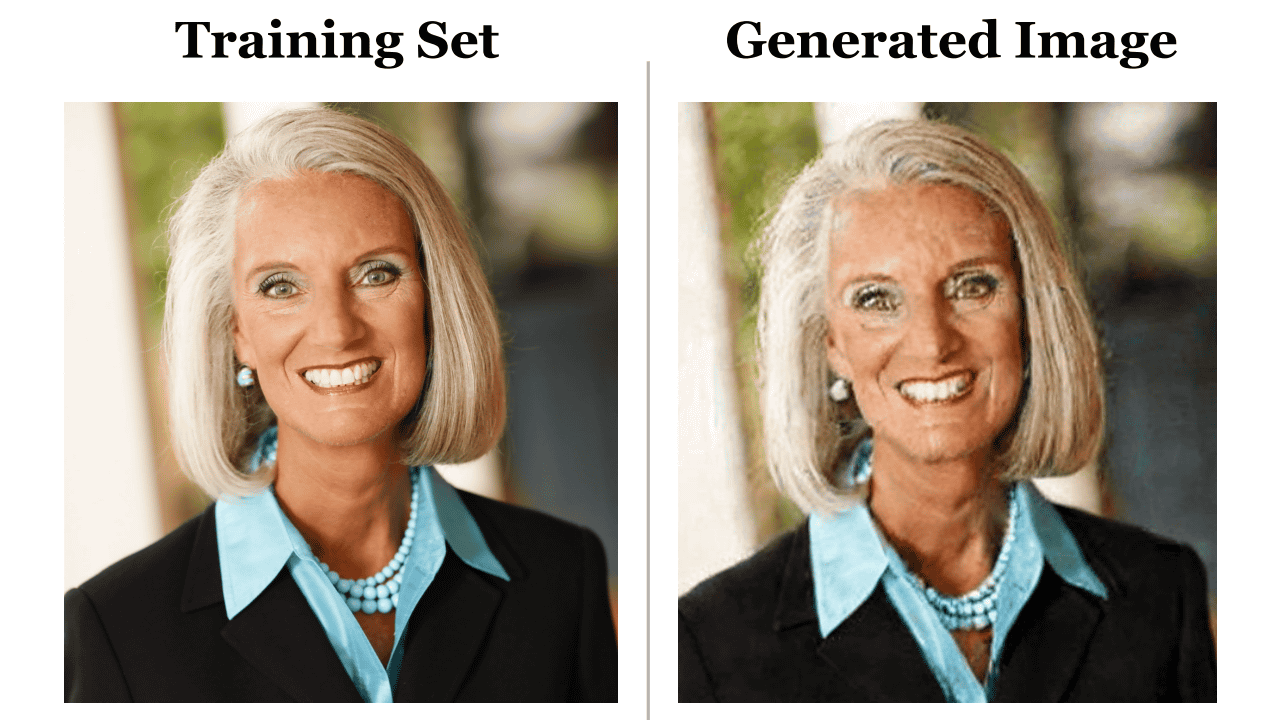

データセットに入っている人の顔と酷似した顔が復元されてしまう可能性を検証した論文を紹介した記事があります。確率は極めて低いですが、同じデータが複数あれば過学習となり、酷似した画像が復元される確率が上がります。これはマリオやトランプ元大統領が名前を書くだけでそのまま出てくる理由です。一般人でも話題性があれば危険がないとはいえません。

論文の著者は「医療画像のようなプライバシーに敏感な領域に現在の拡散モデルを適用しないように忠告した」とあります。

原文です。

And he advised against applying today's diffusion models to privacy-sensitive domains like medical imagery.

似た顔が出る可能性がある以上当然だと思います。

そうでなくても拒否したい人がいるはずです。

GIGAZINEは生成AIに関する海外のニュースをよく邦訳紹介しており、役に立ちます。しかしこの記事の日本語版にはこの部分はありません。海外の記事は原文をお読みください。

日本人の医療写真もLAION-5Bで見つかります。開発側の研究者も医療画像は拡散モデル(顔が復元されるリスクがある)を使わないように忠告しています。

日本人にとっても他人事ではありません。

にもかかわらず問題が伝わりにくい理由の一つに日本語でデータセットの問題を書いた記事が少なく目に入りにくいことがあると思います。他のデータセットの中身も公開されないと、ユーザーも何も知らないままトラブルに巻き込まれる危険があります。

生成AIを非現実的な優しいロボットや妖精に喩えたりせず、事実に沿って仕組みやデータセットの成り立ちをユーザーに隠さずに伝えてほしいと思います。リスクを知った上でどんな規制が必要か他人事でなく考えてほしいと思います。

理由は不明ですが凍結されたことがありますので、念のためにXの投稿をこちらにまとめました。