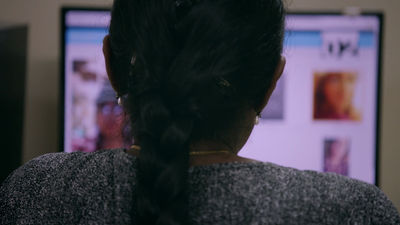

SNSやモバイルアプリから違法性のある閲覧注意のコンテンツを削除する仕事があります。

ネット監視員という言葉で求人が行われています。

一般にはコンテンツモデレーターと呼ばれる仕事です。

プラットフォームが事前に表現規制をしているわけです。

やってみたいと思う人はいるかもしれません。しかしその仕事は想像以上に過酷で精神に負担がかかります。人が殺害される瞬間や、暴力的なポルノも見なくてはなりません。それも大量に。

日本のネット監視員経験者の動画も投稿されています。

短期間で退職する、通院を余儀なくされる人もいます。

SNSから削除されても、投稿できるサイトはあります。そうした

違法性のあるサイトからもスクレイピングは行われています。

集めたデータはそのままではAI学習に使えません。説明する言葉をつけて、言葉と画像の結びついたデータを作ります。ポルノや児童ポルノ、斬首などの暴力的コンテンツも同じように処理されています。それは人間でなければできません。

IT企業からAIの学習作業を受注するインド企業を取材した記事を見ると過酷な低賃金労働の実態がうかがえます。

特に問題のあるデータはフィルタリングされます。しかし不完全です。データセットの中にポルノや児童ポルノ、盗撮や殺人事件の被害者の遺体の写真まであることは何度も書いた通りです。

LAION-5Bのデータはhaveibeentrained.comで検索できます。児童ポルノが入っているといっても画像を上げるわけにいかないので言葉で説明します。入学前の女児が成人男性に囲まれ両腕を押さえつけられて抵抗する写真、両手足を拘束されて吊るされ、成人男性に弄ばれる男児の写真がありました。

女児の方はオプトアウトが進んで酷い写真は見つからなくなっていますが、既に公開済みのStable Diffusionはオプトアウト前のデータセットを使ったものです。オプトアウトに応じた製品はまだ公開されていません。それでも違法コンテンツの多くはそのまま残っています。盗撮などオプトアウトしようがありません。

オプトイン(許諾した人のみを学習元とする)以外根本的な解決法はないと思います。

欧米では学習元の著作権を始めとするデータセットの問題で訴訟が起きており知られていますが、日本では報道が足りないせいか、何も知らずに使っている人が多いように見えます。

海賊版が学習に使われていることも知らないのでしょうか?

読者には海賊版を利用するなといいながら、クリエイターが平気で使うのは理解できません。

私はどこの団体にも所属していませんから、仮に漫画関係の団体がAIを推奨する声明や広告や商品を出しても関与していませんし

少なくとも現状では賛同しません。