ネットに無断で写真を掲載されたくない、無断利用されたくないのは、悪用される危険が伴いますから当然だと思います。

事件や災害の写真をSNSに掲載し、報道機関から使用許可の申し入れを受けた場合は、公益を考えて協力する人もいますが拒否も可能です。

生成AI開発企業による、写真を含めた情報収集は無断で行われています。AdobeもAdobe Stockユーザーに事前に通告したわけではなく、オプトアウトを求める人はいますが許可されていません。

またAdobe Stockに無断転載された画像もあります。

絵や写真を無断で使われたくない、というのはイラストレーターや漫画家ばかりではなく、誰でも同じです。

そして、報道機関の要求に対しては、断ることもできます。

しかし生成AIは無断で使用しています。

断る権利は特権でも何でもありません。当たり前のことです。

私の絵はStable Diffusionの学習用データセットLAION-5Bの中にありました(他はデータセットが非公開なので不明です)。

検索で探す時に「日本、日本人、漫画、女性」で出てきました。さらに絵によっては「サスペンス、不倫、虐待」という単語で出ました。説明は間違っていません。

絵は成人女性、成人男性、女児、男児の4パターンありました。

必要な処理ができています。他の人についても同じでしょう。

説明のつけられた学習用データを用い言葉から画像が生成できるように学習が行われます。

Stable Diffusion はその学習済みモデルとソースコードを公開しユーザーは生成した画像の権利、商用利用を認められます。

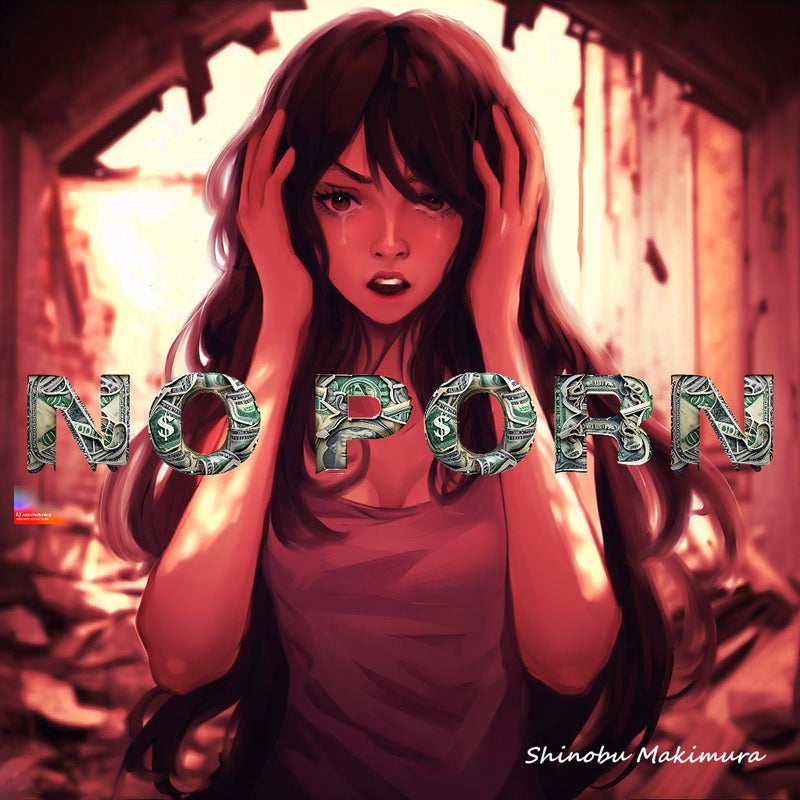

それを悪用して児童ポルノを作り収益化する人もいるわけです。

日本ではモデルの特定できない絵は児童ポルノとはみなされないことが悪用されています(わいせつ物認定はありえます)。

この学習の段階で使われたデータセットの中に、私の作品も含め著作権のある絵や写真等のデータ、違法性のある海賊版や盗撮、ポルノや児童ポルノ、流出した医療写真まで入っています。

だからこそ版権のある絵やポルノも生成する能力があるのです。

悪意のあるユーザーが簡単にポルノを作れることは最初から問題にされていました。悪用を防ぐため不完全ながらフィルタリングされましたが、ユーザーによりフィルタリングは無効化され使われています。

悪意のないユーザーも批判を浴びるのは、元のデータの集め方、中身に問題があるからです。生成AIを開発したのは主に米国企業です。その部分については日本の企業には責任はありません。

事情を知らずに版権キャラを出して批判を浴びたり他人のパクリだといわれてしまったユーザーは、情報不足だとは思いますが、根本的な責任がユーザーにあるわけではありません。

Adobe Fireflyも問題はありますが、少なくともポルノは作れません。ポルノのデータがなければポルノは作れません。

問題にしているのはデータセットがクリーンではないことです。

そこを日本企業がクリアしてくれるなら反対しません。

しかし問題があるとわかっている現在の生成AIを使っている企業は支持できません。いまだに居直って版権キャラやパクリを生成する人、ポルノを作る人に、自主規制は期待できません。

顔を使ってディープフェイクポルノを作られた被害者には自殺者も出ています。加害者の軽さと被害者の受ける深刻なダメージにギャップがあります。

データセットの再構築と著作権者の権利の保護、悪用を防ぐ技術開発と法規制が必要だと考えます。

開発そのものに反対はしていません。