気分の悪くなる話が続いて申し訳ありません。

Stable Diffusionが使用しているLAION-5Bに含まれる画像を検索できるアプリを使って児童ポルノ等の違法なデータを見つけたことはすでに書いています。

女の子の写真については、現在児童ポルノとみなされる年齢18歳を下回ヌード、ポルノが時間をかけずに見つけられます。

盗撮サイトに掲載された下着の見える女子高生の写真、年齢不詳の少女と成人のポルノ、海外の少女のヌードも出ました。

17歳と書かれている日本人の少女のヌードも出ます。

関心のある方は英語で気になる名前を入れて検索してください。

男の子についても性犯罪被害者の写真が名前入りで出てきます。

殺害された犯罪被害者の遺体の写真まで出てきます。

もともとネットがそうした画像を無断転載する違法サイトを含み、いくら削除しても転載が繰り返されているゴミ箱ですから、学習すればゴミを拾うことは避けられません。

LAIONも違法なデータは可能な限り削除していると弁明していますが、嘘ではないと思います。テッド・バンディで検索しても被害者の女性の写真は出ません。しかし犯罪に絡む写真は出てきます。追加学習する利用者もいるでしょう。

最初に報告した児童ポルノは検索結果に表示されなくなりましたが、データが削除されているかどうかは不明です。

違法画像を掲載しているサイトの管理者はまともな人間ではありません。個人で交渉するのは危険です。危害を加えられる恐れもあります。

無断転載される写真の多くは、権利者自身が掲載していません。無断利用を拒否しているということです。それを画像を生成するために使うことに遺族が同意するでしょうか?勿論、犯罪被害者に限らず一般人のブログの肖像写真も出てきます。

少なくとも私は同意できません。

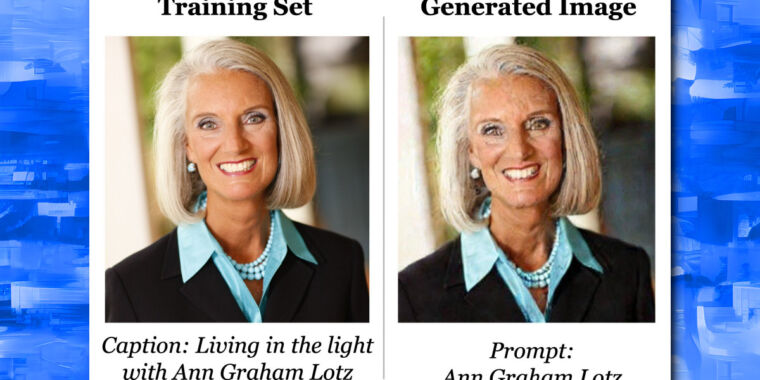

画像生成AIは学習に使ったデータセットから元の画像に酷似した画像を生成できることが確認されています。一致率は非常に低いですが可能です。データセットに同一の画像が重複して含まれると過学習が起こり、記憶という形で残ります。

日本語版は抄訳で、プライバシーの問題に言及した部分をカットしていますが原文では医療情報のようなプライバシーに関わる領域に現在の拡散モデルを適用しないように助言しています。

以下機械翻訳でその部分を引用します。

改善されるまでには期間がかかるはずです。現時点でもそっくりそのまま画像が生成される可能性は低くても、営利目的で無断で使うことが妥当かどうかは一般の意見も求めた上で検討すべきだと思います。