2022年に公開されたStable Diffusion(ステーブル ディフュージョン)はStability AI社が開発した無料画像生成AIです。

現在使われている画像生成AIの中で最も人気が高く、プログラムの中身が無料公開されており、これを基に作られた派生モデルも多数あり、商用利用されています。

ネットで見かける完成度の高いAIイラストや写真集、漫画の多くはこの画像生成AIを使用しています。

性能、使い方についてはこちらの記事がわかりやすいのでご参照下さい。

そのStable Diffusionにユーザーが使いたい画像を追加学習させ生成結果を調整して特定の人物やキャラクターや絵柄を生成できるようにしたLoRA(Low-Rank Adaptation)モデルも、無料でDLできるため爆発的に利用者が増えています。

「ブラック・ジャック」の新作でも使うと発表されています。

遺族は著作権者ですから過去の絵を使用する権利はあります。

しかし権利のない人が実在の有名人や版権もののキャラクターを再現すると肖像権や著作権を侵害する恐れがあります。

有名でなくても全ての創作物には著作権があり、全ての人に肖像権があります。有名でなければ構わないということはありません。著作権のない人は使用しない方が無難です。

自分の絵を追加学習させるだけなら権利問題は生じません。

しかしLoRAモデルはStable Diffusionモデルを追加学習させることにより微調整して使う仕組みです。

Stable DiffusionはLAION-5Bというデータセットを使っています。LAION-5BはドイツでAI向けの研究目的で作られたもので、主にネットから収集された約58億枚の画像のデータとタグ付けに利用できるテキスト処理が施されたデータが入っています。画像データそのものが入っているわけではありませんが、データの中に個人の医療情報や児童ポルノなど違法性のあるものが含まれていることはすでに報道されています。

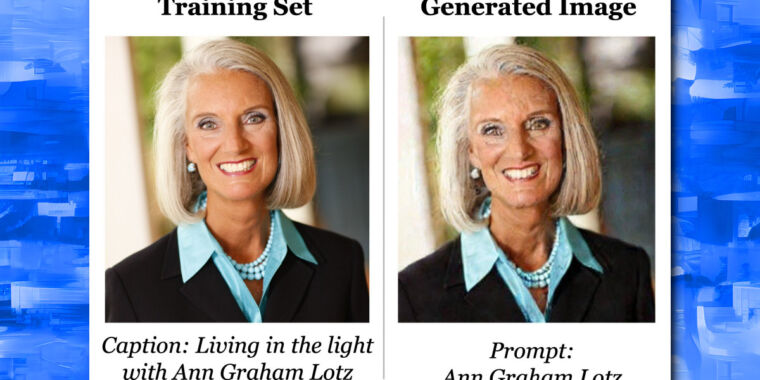

それでもAIから元画像を取り出すのは不可能だから肖像権は気にする必要がない、という説明もありますが、嘘です。

Stable Diffusionはデータセットの中の画像と近似した画像を生成することもあります。確率は低いですがないとは言えません。

学習を繰り返すと近似した画像を生成する確率は上がります。

私自身、LAION-5Bに含まれるデータを検索して、女性写真家Sumiko Kiyookaの名前で大量の無修正ポルノと、女児が手足を押さえつけられている児童ポルノを見つけました。写真家の作品ではありませんが、知名度を利用したポルノだと思われます。女性芸能人Rie Miyazawaでも別人のハメ撮りが出てきました。気分が悪くなり途中で閲覧をやめましたがこうしたデータが大量に含まれている可能性があります。

追記

指摘した児童ポルノとハメ撮りは検索結果に表示されなくなりましたが、データが削除されたかどうかは不明です。LAIONは画像データを保持しているわけではなく、画像が上がっているサイトで対応してもらわなければ消えません。

関心のある方は「Have I Been Trained?」でアルファベットで姓名を入力して検索してください。

報道では知っていましたが、自分の目で画像を見てしまったためStable Diffusionは試用できません。

ネットで見る限りアーティストは著作権侵害に反発しています。

アーティストの作品が無許諾で学習され商用利用され、米国ではフェアユースに当たるかどうかが問われ、著作権侵害等を訴える複数の訴訟を起こされています。

その外にアーティストでない一般人の権利が無視されている現状があります。全ての人の個人情報を何も考えずに利用することを追認できません。

欧州議会は14日世界初となるAI規制案を採択しました。

個人情報の利用について「許容できないリスク」から「最小限のリスク」まで4段階に分けて規制を求めています。

日本でも著作権だけでなく無視されてきた個人の権利を守るための規制を検討すべきだと思います。

「「Chat(チャット)GPT」など生成AIを提供する企業に、透明性の担保を要求する。画像などにAI製だと明示させ、AIが著作権で保護されたデータを取り込んだ場合に公表を求める」

— 水野 祐 CITY LIGHTS LAW (@TasukuMizuno) June 15, 2023

ChatGPTなどAI製のコンテンツ明示を EUが規制案を採択 - 日本経済新聞 https://t.co/YYz5WrVHfW