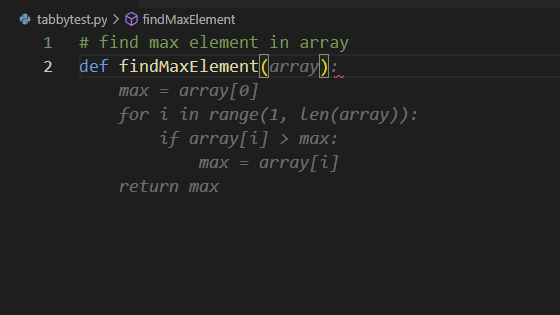

今日、GitHubのCopilotのように使えるローカルのパソコンで実行できるAI?を知り、試しました。

tabbyという名前ですが最初に見たときに、Taddyというターミナルソフトの名前と一緒?と間違えてしまいました。

こちらに、記事を書きました。

今回基にした記事は、こちらです。

この記事の中に、RAMが32GBとありましたが、私は16GBでも動きました。

でも、32GBあった方が、他のソフトも使えるので安心だと思います。

ローカルのパソコンでAIの学習モデルを動かすためには、GPUの性能や内蔵ストレージの空き容量、CPUパワーに加えて、RAMの容量も多い方が良いです。

いよいよパソコンのRAMが32GBあった方が良い時代になったのだと思いました。

良いGPUを使うために、ノートパソコンよりもデスクトップパソコンを選び、タワー型のモデルで自分でグラフィックボードを付けることが出来るモデルも良いと思います。