昨日の記事で、拡散モデルは特定の素材を記憶して再現する能力がある、それがCSAMであれば特定の被害児童の被害の再生産になる、と書きました。

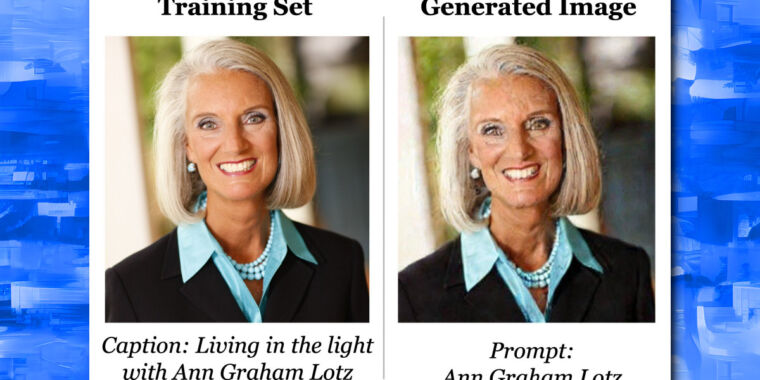

言葉ではわかりにくいので画像で例を上げます。

再現能力の高い(問題のある)StabLe Diffusion1.5でプーチンの

フルネームを英語表記でプロンプトに書いた生成結果です。

似ています。似ていない画像がありません。

素材の多い有名人は高確率で酷似した画像が生成されます。

同じ素材がLAION-5Bにあるかどうかhaveibeentrained.comで検索しましたが、全く同じ素材はありませんでした。

StabLe Diffusionはプーチンの外見の特徴をつかみ、同一人物に見えるように特徴を保ちながらアレンジして生成しています。

瞬時にこれほどのことができる能力は人間にはありません。

ゼレンスキー大統領では再現度が落ちます。元になる写真、素材が少ないからです。生成数が多ければ類似した画像が出てくると思いますが、一度では見劣りする結果になりました。

2人のフェイクニュースを作ってみました。手が崩れていますが修正すれば使えます。

こうした使い方ができるためリスクがあります。

それにしてもプーチンは再現度が最強です。

StabilityAI社のエマド・モスタークの名前で生成してみましたが似ていません。ゼレンスキーよりさらに素材が少ないためです。

素材が多ければ再現され、少なければ再現度が低いことはわかりました。しかし回数を重ねれば誰でも酷似した画像が再現される可能性があります。それを検証した記事です。

CSAMにも素材の多い被写体がいます。その女児の特徴を保ったAI CSAMが生成される可能性があります。生成の繰り返しにより性的虐待の再被害化が続きます。これがデータセットにCSAMがあってはまずい理由です。

StabLe Diffusionのモデルに加えてLoRAを使い、好みの被写体を追加学習させれば安定して再現できるようになります。LoRAは少数の追加学習で望む結果を得られるため便利に使われますが悪用が目立ちます。

しかしLoRAの使用を規制しても、性的画像の生成を禁止したとしても、人間ですから悪用は止まらないでしょう。

ご承知だと思いますが、生成AIはデータセットに存在しないものは生成することができません。

ですからCSAMもない、CSAMに加工できる成人のヌードもないデータセットを使えば、どんな人間が悪用しようとCSAMを作ることができません。CSAMに限らず医療写真でも個人の肖像でも同様です。権利者の許諾を得たデータセットを使うべきだと考えます。

LoRAはStabLe Diffusionのモデルに依存していますから、単独では悪用できません。

ちなみに純粋に研究目的に限れば、何を使っても構わないと思います。研究なしでは何もできません。しかしそれを一般公開して商用利用させることには反対です。その結果が現状です。

問題だといっているのは海外の製品です。日本にはそれを使ってほしくありませんし、使っている企業には自省してほしいと思います。悪用したい人を後押ししてしまうことにもなります。