生成AIを使ったディープフェイクは昔からあるクソコラやアイコラとは明白な違いがあります。本物と見分けがつかない精巧な画像が簡単に作れるので被害が深刻だということはよくいわれますが、それ以前に

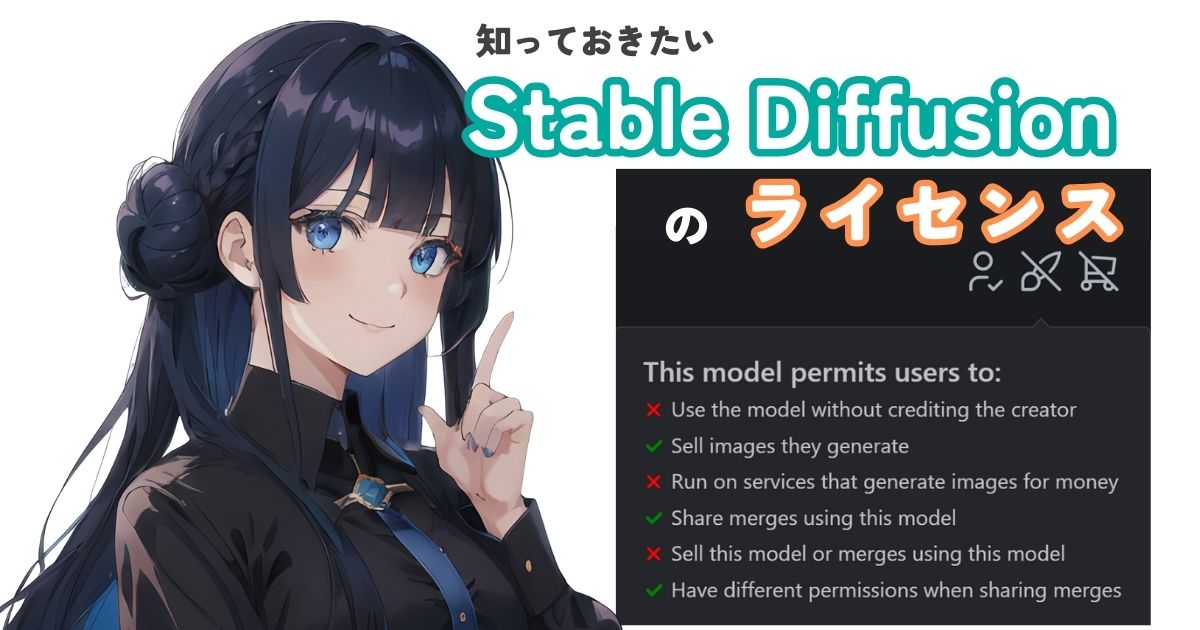

開発企業が公開している

利用規約に違反しています。

児童ポルノ生成に使われるStable Diffusionの利用規約を確認してみます。

邦訳全文(非公式)はこちらにあります。

「未成年者を搾取し、害し、または搾取もしくは害しようとする目的での使用」、未成年者に限らず「他者に危害を加える目的で、検証可能な偽の情報および/またはコンテンツを生成または流布すること」を禁止しています。

児童ポルノや人を傷つけるディープフェイクの生成、配布はこれに該当します。

嫌だという人が「反AI」呼ばわりされるなら、禁止している開発企業が「反AI」ということになってしまいます。

AI児童ポルノは現実の被害児童と無関係ではありません。

性的虐待を受けた実在児童の写真から生成されていることがわかっています。

それ以前に、StableDiffusionが使用した学習用データセットLAION-5Bには実在児童のポルノがあることもわかっています。

haveibeentrained.comで確認できます。これは未成年者の搾取ではないのでしょうか。

生成に使われた被写体が特定できなければ、法的な扱いは現実の児童と同じにはなりません。(日本ではわいせつ物頒布等罪に当たる可能性はあります。)ネットの画像の削除より実在の被害者救済を優先すべきことは当然としても、写真に見えるAI生成画像の氾濫により、警察は通常の捜査に加え本物と偽物を見極めなければならず、既存の追跡システムが混乱しています。将来的には区別するシステムができるかもしれませんが少なくとも今はできていません。

AIを使用したセクストーションも増加しています。

AI生成児童ポルノ(日本では児童ポルノではない)や、特定の個人を傷つけるディープフェイクは開発企業の利用規約に違反し、警察の捜査の妨害にもなっています。

従来のコラージュと同じくパロディや風刺もできますから表現の自由は尊重すべきです。ディープフェイクを全て禁止することはできません。

しかし現実には人を傷つけるディープフェイクの悪用が野放しにされています。データセットの中の被写体を使用していることが明らかなディープフェイクポルノ、児童ポルノに対しては新たな法規制が必要だと考えます。