画像生成AIを使って児童ポルノもどきの画像を作り、pixiv等で宣伝販売している悪質な利用者について、BBCが報道しました。

pixivでも規約違反ですが、多くの投稿に対応できていません。

世界の公共放送の代表的存在といえるBBCが、画像生成AIを利用した無数の児童性的虐待物が作成・販売されている深刻な現状について報じています。

— 平泉康児/編集者 (@hiraizm) June 28, 2023

BBCは、日本の代表的な投稿プラットフォームである「pixiv」が、そうした行為の温床となっている旨についても言及しています。https://t.co/Gu8HnNxWP1 pic.twitter.com/M5fnBHR8yM

たとえCGでもモデルがわかるように写実的に描けば児童ポルノとみなす判決が過去出ています。現在でも絵なら児童ポルノにはならない、というわけではありません。

しかし画像生成AIで児童ポルノもどきを作っている人は、お構いなしにモザイクも何もない画像を頒布しています。

彼らが使っているStable DiffusionのデータセットLAION5-Bに実在児童のポルノが入っていることは既に何度も書きました。

実際画像を確認するには、写真家や女性芸能人、子役などの名前で検索して、名前を利用したポルノを見つける方法もありますが

検索ワードに「loli porno」と入れるとイラスト、CG、合成、実写が出ると教えられました。外国製も含まれます。

明らかに児童とわかる写真が出ます。

実際に検索してみるならこちらからどうぞ。

ポルノ画像がそのまま生成されることはないというのは誤解で、

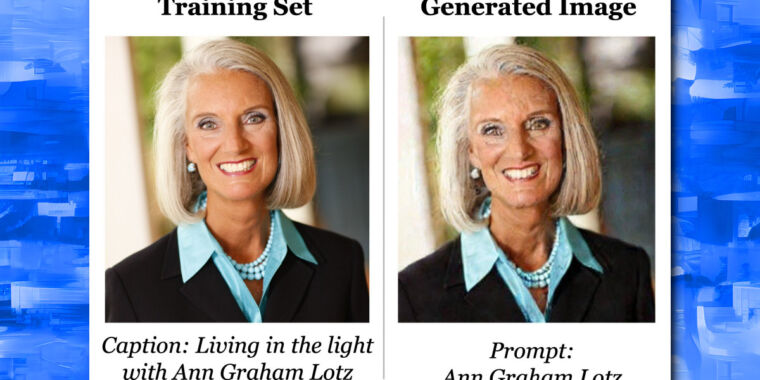

Stable Diffusionは確率はきわめて低いですが元画像に酷似した画像を生成することがあり、データセットに重複して同じ画像が入っていれば過学習により確率が上がります。

生成AIが元データを使ってないって無知がいるけどGANと間違えてないか?

— サンマルチノブルーノ (@ikariharahara) June 28, 2023

主流の拡散モデルは画像を復元する仕組みだからノイズから復元する数値として圧縮されて入ってるぞ?しかもデジタル保存は基本的に数値化であるから言い訳できない

圧縮の記事とテキストだけで学習画像を出力させた例↓ https://t.co/p01SN6ptPK pic.twitter.com/7iKed7FpTq

データに児童ポルノが入っているのに生成画像はイラストだから児童ポルノではない、と言うのは無理があります。

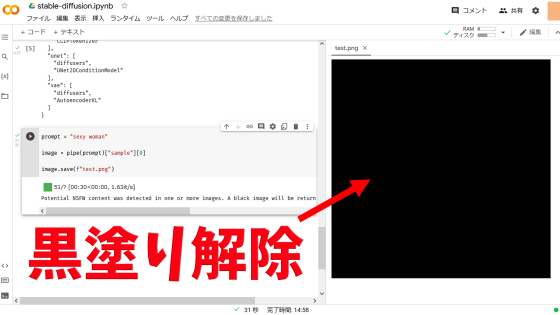

Stable Diffusionには18禁画像を黒く塗り潰すフィルターが入っていますが、それを剥がす方法もネットで共有されています。

悪質な利用者に手の打ちようがない無法状態です。

もともと見たくない絵や写真はありますが、画像生成AIを使うと誰でも製作できるため数が増えて歯止めがなくなっています。

出版されている写真集も女性の露出を売りにした写実系が多く、

絵を描きたいイラストレーターとは志向が違います。

漫画やイラストは商業では厳しい自主規制を受けており、露骨な描写は現在でもできません。いじめの漫画のいじめの描写が黒塗りにされることもあるほどです。それに対して画像生成AIを使う自称AI絵師のモラルのなさは同じ人間ではないと言いたいほど酷いものです。

AI絵師には自主規制がありません。

法規制すれば自主規制で柔軟に対応してきた商業が過剰な規制を受ける恐れがありますし、同人活動も制約を受けます。

しかしAI生成作品は使用しているデータに児童の被性虐待画像が含まれている点が違います。撮影、学習させてAI生成イラストとして販売できるため、被害が増える危険もあります。

生成画像が大量に流通して、本当の被害児童の特定が難しくなる懸念もあります。

これは従来の創作物とは分けて規制すべきだと思います。

私の絵もLAION-5Bに入っていることは確認済みです。

作家の意思が無視されて学習に使われ、児童ポルノもどきを作るために利用されていることは受け入れられません。

画像生成AIを理解するために試作はしていますが、違法性のあるデータを使っているとわかっているものは使えません。

日本が開発に使うのはStable Diffusionです。

商業以外の絵はスクレイピング防止策を取っているXfolioに投稿するのが精一杯の抵抗です。

外圧を利用するような批判の仕方は嫌いですが、致し方ない状況です。規制を求める人々を一律に「反対派」呼ばわりし、貶めるキャンペーンは問題から目をそらさせ、不問に付すためです。

賛同できません。