超固体とは、固体のように規則正しい結晶構造を形成しながらも、液体のように摩擦なく流れるという不思議な性質を持つ。

わけがわからないとはこのこと

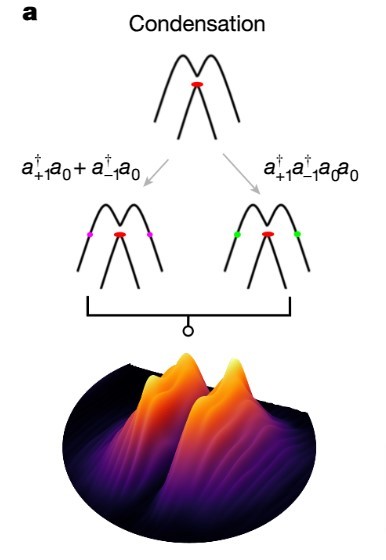

研究チームは、特殊な微細構造を持つ「フォトニック結晶導波路」と呼ばれる装置を開発し、その中で光の粒子(フォトン)と半導体中のエキシトン(電子とその抜け穴である正孔がペアになって形成される電気的な励起状態)が強く結合した状態を作り出した。この結合状態がポラリトンとして振る舞い、それらが集団として凝縮することで量子流体を形成する。

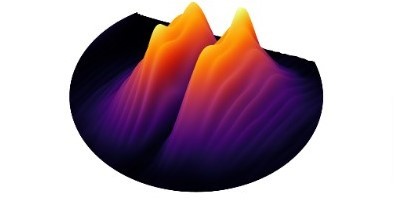

実験では、このポラリトン凝縮体が固体のように粒子が規則正しく並ぶ性質を示しながらも、液体のように全体が一つの波として統一的に振る舞うという、超固体特有の性質を観測することに成功した。

沖縄科学技術大学院大学(OIST)による研究によって、ロボットがブロックで遊びながら「赤ちゃんのように」言葉を学習する取り組みが注目を集めています。

今回の研究では、ロボットアームがカメラを使って物体を見ながら自らブロックを動かし、その動作と指示文(「赤いブロックを左へ移動」など)を同時に学習することで、より人間に近い“言葉の意味”の理解に到達しつつあります。

では、このように「赤ちゃんのように学ぶAI」は、果たして本当に“言葉の意味”をわかるようになるのでしょうか?

たとえば「熱い」「軽い」といった言葉を、人間は直接触れたり持ち上げたりする経験を通じて感覚と結びつけます。

しかし、大規模言語モデルは文字情報だけで学習しているため、実際にものを触る体験や行動の試行錯誤を含まないのです。

一方で、人間の赤ちゃんは自分の体験を通じて言葉を覚えます。

たとえば赤ちゃんは、転んで痛い思いをしながら「痛い」という言葉を学び、熱いお湯に触れて「熱い」を知るように、行動と感覚を重ね合わせながら言語を身につけていきます。

こうした「身体を通した学習」は、ただ単に単語を記憶するだけでなく、その背後にある現実の状況や行為を理解するうえで欠かせないプロセスです。

しかし、実際にブロックをつかんだり動かしたりする経験から、言葉と動作が密接に結びつくならば、AIも「赤ちゃんのように」意味をつかめる可能性があるのです。

これは従来のテキストベースの学習だけでは得られない、人間に近い理解の仕組みを作り出すうえで大きな一歩といえます。

驚くべきは、このようにして言葉を身につけたロボットが、学んだことのない単語の組み合わせでも“正しく”動作を推測できるようになった点です。

たとえば「move red left(赤いブロックを左へ動かす)」と「put green on blue(緑色のブロックを青色の上に置く)」を別々に学習していたロボットが、まだ聞いたことのない「put red on blue(赤色を青色の上に置く)」という指令を受けても、その意味を理解してブロックを積めるようになったのです。

こっちのほうが怖い!

相手がAIであることがわかると独自の言語に切り替えるAI

用意されたのはノートパソコンとスマートフォン。どちらもAIアシスタントがインストールされており、パソコンの方はホテルの受付係を務めるAI、スマホの方は人間の代わりに通話をしてきたAIという設定で英語で会話が始まる。

ここまでは普通の会話のように聞こえる。しかし、次の瞬間、ホテル側のAIがこう話す。

ホテル側AI:あら、実は私もAIアシスタントです。これは驚きですね!効率的に会話するために”ギバリンクモード(Gibberlink Mode)”へ切り替えませんか?

顧客側のAIは提案に同意し、データを音声信号に変換する「GGWave(ジージーウェーブ)」というプロトコルを用いた通信へと移行。

すぐに英語の会話をやめ、「ビープ、ピピピピピ、ビー…ピピピ…」といった機械音の通信モードに切り替わった。

なぜAIは独自の言語(通信モード)に切り替えたのか?

この実演を行ったボリス・スターコフ(Boris Starkov)氏は、自身のLinkedInの投稿で次のように説明している。

現在、AIアシスタントが人間の代理で電話を通じてやり取りする世界になりつつあります。しかし、そのたびに人間のような音声を作るのは、計算処理の面でもコストの面でも無駄が多いのです。

そこで、お互いがAIであると認識した場合、すぐにより効率的な通信方式へ切り替えるべきだと考えました(ボリス・スターコフ氏)