マシーンラーニング(ex4)

なんだかアクセスが急激に増えちゃいました。

続きをのっけとこ。。。

第四週

誤差逆伝播型(バックプロパゲーション)のニューラルネットワークの構築です。

まづ、

先週書いた順伝播型(フィードフォワード)のニューラルネットワークを

改良し、任意の大きさのデータセットと任意の数のラベルに対応できるような

汎用型にします。

今回のニューラルネットワークは

入力ユニット

隠れたユニット

出力ユニット

のわずか三層で構成されていますが、

それぞれのユニットを構成する因子の数は限定されていません。

ベクトル表記により

どのような因子数にも対応できるようなプログラムにします。

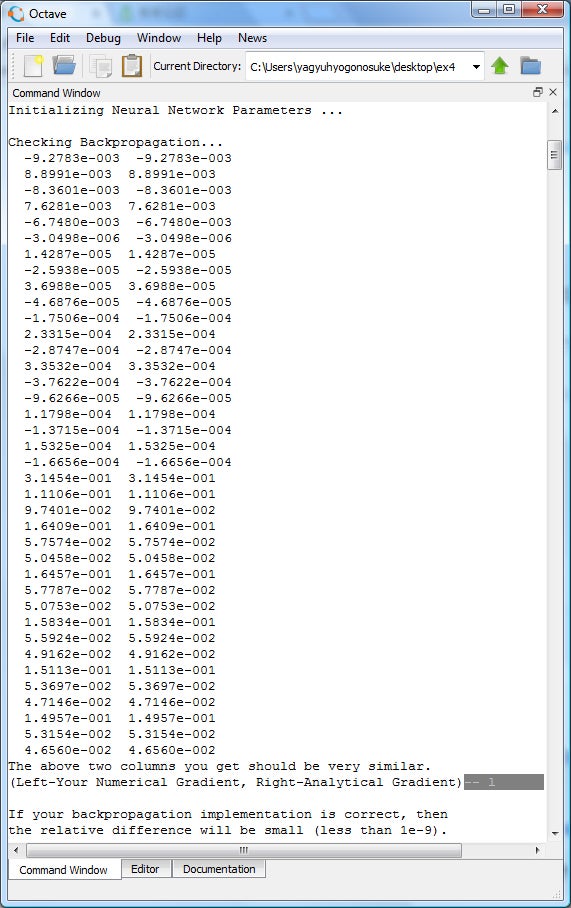

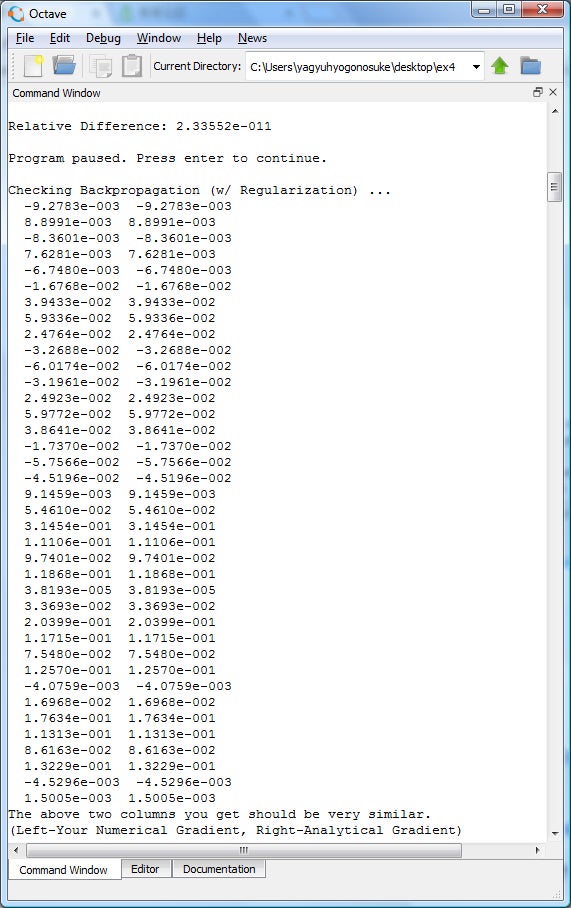

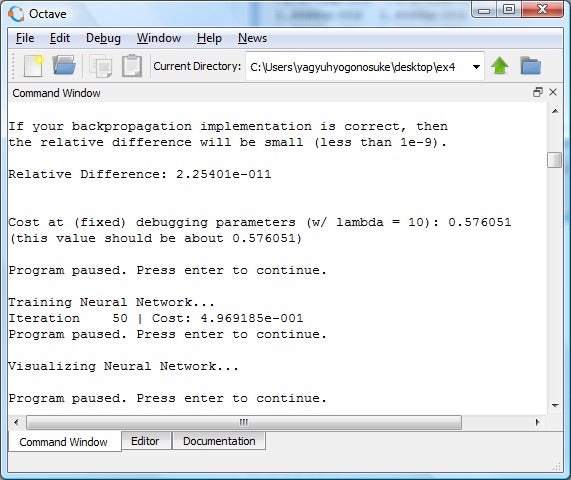

つぎに誤差逆伝播型(バックプロパゲーション)のニューラルネットワークを構築します。

できたのを走らせると。。。

さらに改良を加え。。。

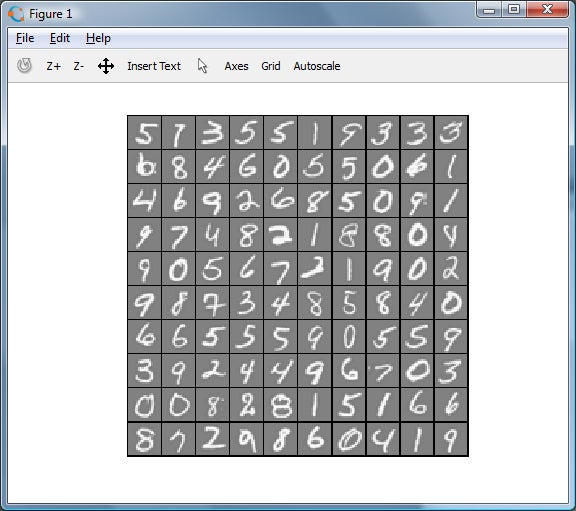

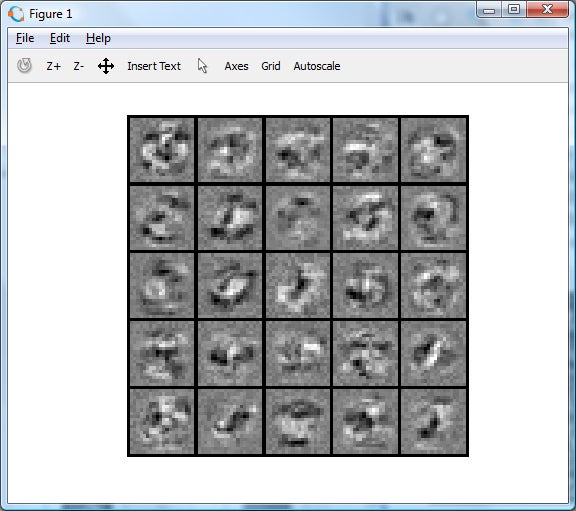

んで、ここで、ニューラルネットワークがどんなことを学習しているのかを

理解するために、隠層を可視化してみます。

あとはいろいろなパラメータを試してみます。

ニューラルネットワークはパワフルなので、大変複雑な領界を形成できますが、

regularization をしないと、トレーニングセットにオーバーフィットしてしまい、

トレーニングセットにはほぼ100%一致するのですが、新たなデータセットに対しては

うまくいかなくなることにもなります。

そこでregularization パラメータのλをいろいろと試してみて

ネットワークの挙動を確認していきます。

(続く。。。)