AGIの相互監視が肝

アンチAIの主張は参考程度にするべき

AIの急速な進化により、いわゆる「アンチAI」は全世界で増えている。

- 著作権侵害のリスク

- ハルシネーション

- 情報漏洩のリスク

- ブラックボックス化

- 責任の所在不明

多くの「アンチAI」の主張は、上記のような事項であろう。

したがって、AIの本質を理解していない一般人がよく口にする言葉は、「AIは怖い」「AIなんて信じられない」などだ。

しかし、このようなレベルのことは、専門家を始めとした様々な人たちが、すでに深く考えていることなのである。

https://data.wingarc.com/layered-intelligence-1-77945

Open AIが推し進めるAGIが、次第に陰りが見えてきている。特定用途に特化したSLMは、逆に急速な進化を始めた。多様化しつつあるAIが、今後は機能分担して階層化していくという独自の考え方を、今回話してみる。

(中略)

やっと先ほどのサルくんの質問への回答になるのですが、図にあるようなAI同士による相互監視が必要ではないかと考えています。サンドボックス内にAIを閉じ込めていては実用化できませんし、やってはいけないリストを作るのも非現実的です。

しかもAGIレベルにまで達したAIの行動を、逐一人間が監視することは不可能だと思います。もちろん完成して実用化されるAGIには、厳しい”倫理教育”をするなど様々なリスク対策をするはずです。

それでも抜け道を見つけてしまう悪意のあるAGIが出現する可能性があります。そのため、多数のAGIが稼働しているなら善意のAGIが多数で、悪意あるAGIの出現はマレという仮定のもとに、その悪意あるAGIを排除するようにAGIが相互監視させようというアイデアです。

AI同士による「相互監視」の必要性は、一定程度理解していたが、

- AGI(Artificial General Intelligence:汎用人工知能)による連携・相互監視

- SLM(Specialized Language Models:専用用途AI)

- SLMs(個人用AI):スマートフォンにおけるGeminiやApple Intelligenceなど

という3階層の「階層化する知能」という考え方は、誰にとってもわかりやすく、現実的なものである。

したがって、冒頭での「アンチAI」の主張は参考程度にしていれば十分なのである。

そういったAIに対する危機感を煽ることよりも、どうすれば「人間とAIの共存」を実現できるのかということを、みんなで考えることこそが、今一番求められていることなのである。

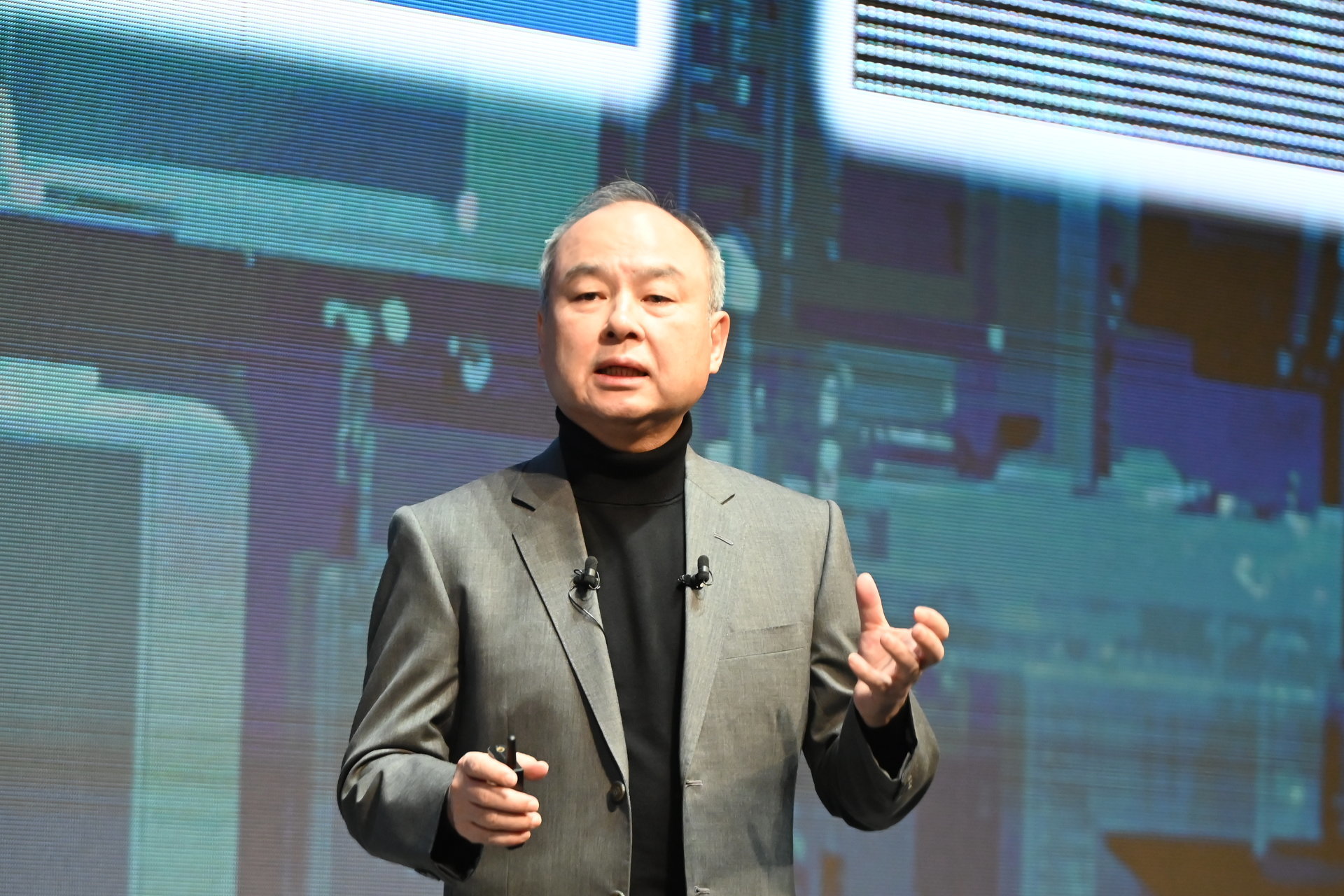

孫正義流を真似してみるべきだ

https://www.itmedia.co.jp/business/articles/2406/21/news178.html