npakaさんのnoteから【Reka Core - フロンティアクラスのマルチモーダル言語モデル】

Reka Coreは、「GPT-4V」Claude-3 Opus」Gemini Ultra」を超えるマルチモーダル。

なんか凄いのがでてきたのでブログに、まとます。

2024.4.15 カリフォルニアを拠点とするAIスタートアップ企業「Reka」はマルチモーダルAI※「Reka Core」を発表しました。

X:Reka

Meet Reka Core, our best and most capable multimodal language model yet. 🔮

— Reka (@RekaAILabs) April 15, 2024

It’s been a busy few months training this model and we are glad to finally ship it! 💪

Core has a lot of capabilities, and one of them is understanding video --- let’s see what Core thinks of the 3 body… pic.twitter.com/5ESvog35e9

※ マルチモーダルAI

マルチモーダルAIは、画像とテキストの組み合わせをはじめとした複数情報の入力に対応しており、それぞれの関係性を理解してより高精度な情報を出力できます。

↳ https://www.reka.ai/news/reka-core-our-frontier-class-multimodal-language-model

MMMUで「GPT-4V」に匹敵し、独立したサードパーティによって実施されたマルチモーダル人間評価では「Claude-3 Opus」を上回り、動画タスクでは「Gemini Ultra」を上回っています。

※ 大規模マルチモーダルモデルのための新ベンチマーク「MMMU」

MMMUは、現在の大規模言語モデル(LLM)と大規模マルチモーダルモデル(LMM)の基本的な知覚能力の限界を示すだけでなく、複雑な推論や深い知識を扱い能力も評価することができます。(情報元:大学レベルの教養に挑む: 大規模マルチモーダルモデルのための新ベンチマーク「MMMU」)

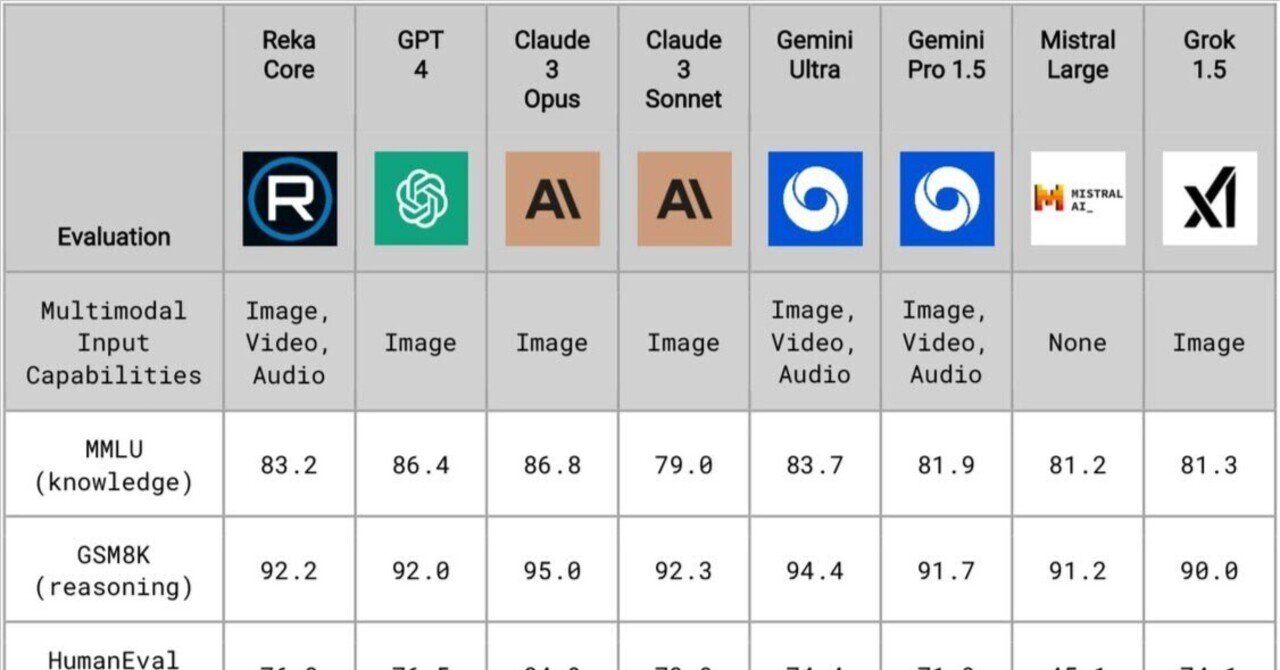

・主要ベンチマークによる主要モデルとの比較

ELOスコアが高いほど、パフォーマンスが優れていることを表します。

[出力例]

・Reka Core 機能

・マルチモーダル (画像と動画) の理解

「Core」は、単なるフロンティアのLLMではありません。 画像、動画、音声を状況に合わせて強力に理解することができ、リリースされている2つしかない包括的なマルチモーダルソリューションのうちの1つです。

・128K コンテキスト ウィンドウ

「Core」は、より多くの情報を取り込み、正確かつ正確に呼び出すことができます。

・推論

「Core」は優れた推論能力 (言語と数学を含む) を備えているため、高度な分析を必要とする複雑なタスクに適しています。

・コーディングとエージェントのワークフロー

「Core」は最上位のコードジェネレータです。 そのコーディング機能を他の機能と組み合わせると、エージェントワークフローを強化できます。

・多言語対応

「Core」は32言語のテキスト データで事前学習しました。 英語のほか、アジアやヨーロッパのいくつかの言語に堪能です。

・Playrounnd

矢印のところを、クリックしてサインアップします。

↳ https://chat.reka.ai/auth/login

ログインして「同意」に✓。「続く」をクリック

うん?「Core・Flash・Edge」なんだろ..

「Reka」について、調べながら遊んでみます。興味がある人は遊んでみて下さい。